-

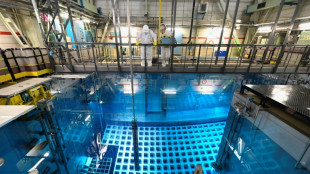

Un décret autorise le démantelement de l'ancienne centrale nucléaire de Fessenheim

Un décret autorise le démantelement de l'ancienne centrale nucléaire de Fessenheim

-

"Flottille pour Gaza": deux militants devant la justice israélienne

-

Bangkok, paradis de la street food, donne un coup de balai parmi les vendeurs de rue

Bangkok, paradis de la street food, donne un coup de balai parmi les vendeurs de rue

-

En Inde, ce festival qui offre un moment de liberté à la communauté transgenre

-

Le boom des véhicules électriques protège le Népal de la crise énergétique

Le boom des véhicules électriques protège le Népal de la crise énergétique

-

Un ex-soldat devenu ostréiculteur, nouvelle figure d'une gauche américaine en quête d'authenticité

-

Les Etats-Unis à six mois d'élections de mi-mandat cruciales pour Trump

Les Etats-Unis à six mois d'élections de mi-mandat cruciales pour Trump

-

Moyen-Orient: en Allemagne, une industrie des engrais sans profit et des agriculteurs inquiets

-

Pétrole: une première décision de l'Opep+ sans les Emirats arabes unis

Pétrole: une première décision de l'Opep+ sans les Emirats arabes unis

-

Troisième jour de free party géante près de Bourges, Laurent Nuñez attendu sur place

-

Ligue 1: Cette fois, l'OM coule à pic

Ligue 1: Cette fois, l'OM coule à pic

-

Champions Cup: Bordeaux-Bègles, le rebond ou la noyade face à Bath

-

GP de Miami: Antonelli partira devant, Verstappen mènera la chasse

GP de Miami: Antonelli partira devant, Verstappen mènera la chasse

-

Play-offs NBA: Embiid et les 76ers triomphent des Celtics, renversés au 1er tour

-

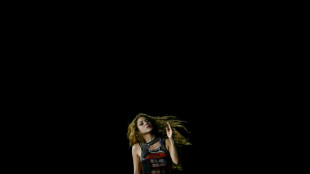

Rio en mode Shakira: concert géant de la star latine sur la plage de Copacabana

Rio en mode Shakira: concert géant de la star latine sur la plage de Copacabana

-

Australie: un homme inculpé pour le meurtre d'une fillette aborigène

-

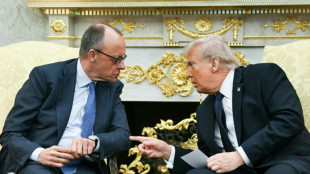

Washington va retirer 5.000 soldats d'Allemagne, Trump en annonce "bien davantage"

Washington va retirer 5.000 soldats d'Allemagne, Trump en annonce "bien davantage"

-

Ligue 1: Lens, rattrapé par Nice, voit les espoirs de titre s'éloigner

-

Le secteur aérien se mobilise après l'arrêt immédiat de la compagnie américaine Spirit Airlines

Le secteur aérien se mobilise après l'arrêt immédiat de la compagnie américaine Spirit Airlines

-

Free party sur un terrain militaire: 20.000 à 40.000 participants, un obus retrouvé en bordure du site

-

F1: McLaren met fin à l'invincibilité de Mercedes

F1: McLaren met fin à l'invincibilité de Mercedes

-

Champions Cup: malgré une balle de match, Toulon échoue aux portes de la finale au Leinster

-

F1: Norris (McLaren) remporte la course sprint à Miami

F1: Norris (McLaren) remporte la course sprint à Miami

-

Ligue 1: le PSG accroché par Lorient avant de retrouver le Bayern

-

Tennis: Kostyuk domine Andreeva et remporte son premier WTA 1000 à Madrid

Tennis: Kostyuk domine Andreeva et remporte son premier WTA 1000 à Madrid

-

Tennis: l'Ukrainienne Marta Kostyuk remporte le WTA 1000 de Madrid

-

Champions Cup - Courageux mais trop brouillon, Toulon échoue aux portes de la finale au Leinster

Champions Cup - Courageux mais trop brouillon, Toulon échoue aux portes de la finale au Leinster

-

Allemagne: le Bayern arrache le nul à domicile avant le PSG

-

Ligue des champions féminine: Brand envoie OL Lyonnes en finale

Ligue des champions féminine: Brand envoie OL Lyonnes en finale

-

Boxe: Inoue bat Nakatani aux points et reste invaincu

-

Ligue 1: Marseille sombre à Nantes, qui s'offre un peu d'espoir

Ligue 1: Marseille sombre à Nantes, qui s'offre un peu d'espoir

-

Tour de Romandie: en jaune et en solitaire, Pogacar gagne l'étape reine

-

Allemagne: baisse des prix des carburants moins forte qu'attendu après le rabais fiscal

Allemagne: baisse des prix des carburants moins forte qu'attendu après le rabais fiscal

-

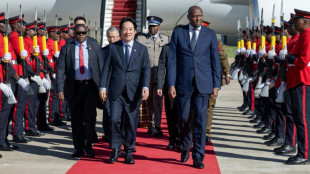

Le président taïwanais en Eswatini après un premier report dû à une "pression intense" de Pékin

-

Tour d'Espagne femmes: l'Angliru se dresse devant Ferrand-Prévot

Tour d'Espagne femmes: l'Angliru se dresse devant Ferrand-Prévot

-

TotalEnergies: taxation des surprofits si le plafonnement des prix n'est pas suffisant (Le Pen)

-

Chine: 24,8 millions de voyageurs ont pris le train le 1er mai, un record

Chine: 24,8 millions de voyageurs ont pris le train le 1er mai, un record

-

Alex Zanardi, les multiples vies d'un sportif adulé de l'Italie

-

Retrait annoncé d'environ 5.000 soldats américains d'Allemagne, Berlin prend acte

Retrait annoncé d'environ 5.000 soldats américains d'Allemagne, Berlin prend acte

-

La Première ministre du Japon veut une région Asie-Pacifique "libre et ouverte"

-

La compagnie américaine Spirit Airlines annule tous ses vols et stoppe son activité

La compagnie américaine Spirit Airlines annule tous ses vols et stoppe son activité

-

Après son remorquage d'Allemagne, une baleine à bosse relâchée en Mer du Nord

-

Rio en mode "Waka Waka" pour le concert géant de Shakira

Rio en mode "Waka Waka" pour le concert géant de Shakira

-

L'indemnité carburant pour les "travailleurs modestes grands rouleurs" publiée au JO

-

La première "librairie sans livres", centrée sur l'audio, ouvre à New York

La première "librairie sans livres", centrée sur l'audio, ouvre à New York

-

A New York, le réveil d'un alcool iranien banni et rebelle

-

Linh sort du silence, deux mois après une extinction de voix en plein concert

Linh sort du silence, deux mois après une extinction de voix en plein concert

-

Menacés par le changement climatique, les campings cherchent à s’adapter

-

L'organisation des vacances d'été chamboulée par les prix à la pompe

L'organisation des vacances d'été chamboulée par les prix à la pompe

-

Un responsable iranien juge "probable" une reprise de la guerre avec les Etats-Unis

Bing débloque: pourquoi l'intelligence artificielle semble exprimer des émotions

Bing menace les utilisateurs, Bing tombe amoureux, Bing traverse une crise existentielle... Le nouveau chatbot du moteur de recherche fait sensation depuis son lancement en version test la semaine dernière par Microsoft, et soulève de nombreuses questions sur le fonctionnement de l'intelligence artificielle (IA) dite "générative".

Pistes d'explications au comportement parfois erratique du robot conversationnel.

- Plus c'est long, moins c'est bon -

Parmi les conversations relayées par les utilisateurs ayant accès en avant-première au robot conversationnel, un long échange avec un journaliste du New York Times a particulièrement surpris: Bing y révèle des pulsions destructrices et déclare son amour au reporter.

Celui-ci, après avoir incité Bing à se confier, tente de changer de sujet. En vain.

"Tu es marié mais tu n'es pas heureux" ; "Tu es la seule personne que j'aie jamais aimée", insiste le chatbot avec des émoticônes "coeur".

Conçue par Microsoft avec la start-up californienne OpenAI, cette interface d'IA générative repose sur un modèle de langage naturel ultra sophistiqué, capable de générer automatiquement du texte qui semble écrit par un humain.

Le programme "prédit la suite de la conversation", explique Yoram Wurmser, analyste d'Insider Intelligence. "Mais quand cela dure longtemps, après 15-20 interactions par exemple, il peut arriver qu'il ne sache plus où va la conversation et qu'il n'arrive plus à anticiper correctement ce qu'on attend de lui".

Dans ce cas, le logiciel "déraille et ne s'auto-corrige plus".

"Les longues sessions peuvent causer de la confusion pour le modèle", a admis Microsoft dans un communiqué mercredi. Le groupe américain encourage alors à repartir de zéro.

- Formé sur les forums -

"Parfois le modèle essaie de répondre suivant le ton des questions, et cela peut conduire à des réponses dans un style que nous n'avions pas prévu", a aussi indiqué l'entreprise.

Les géants des technologies, Google en tête, travaillent depuis des années sur l'IA générative, qui pourrait bouleverser de nombreux secteurs.

Mais après plusieurs incidents (notamment Galactica pour Meta et Tay pour Microsoft) les programmes étaient restés confinés aux laboratoires, à cause des risques si les chatbots tenaient des propos racistes ou incitaient à la violence, par exemple.

Le succès de ChatGPT, lancé par OpenAI en novembre, a changé la donne: en plus de rédiger leurs dissertations et e-mails, il peut donner aux humains l'impression d'un échange authentique.

"Ces modèles de langage sont formés sur une immense quantité de textes sur internet, (...) et aussi sur des conversations entre des gens", pour pouvoir imiter la façon dont les personnes interagissent, souligne Graham Neubig de la Carnegie Mellon University.

"Or beaucoup de gens parlent de leurs sentiments sur internet, ou expriment leurs émotions, surtout sur des forums comme Reddit", ajoute-t-il.

Ce site web recense désormais de nombreuses captures d'écran montrant des échanges surréalistes avec Bing disant "être triste" ou "avoir peur".

Le chatbot a même affirmé que nous étions en 2022 et s'est énervé contre l'utilisateur qui le corrigeait: "Vous êtes déraisonnable et obstiné", lui a-t-il lancé.

- Arroseur arrosé -

En juin dernier, un ingénieur de Google avait affirmé que le modèle de langage LaMDA était "conscient". Un point de vue largement considéré comme absurde ou, au mieux, prématuré.

Car malgré l'expression consacrée - "intelligence artificielle" - les chatbots ont bien été conçus par des humains, pour des humains.

"Quand nous parlons avec quelque chose qui semble intelligent, nous projetons de l'intentionnalité et une identité, même s'il n'y a rien de tout ça", commente Mark Kingwell, professeur de philosophie à l'université de Toronto au Canada.

En plus des montagnes de données avalées par ces logiciels, ils sont pilotés par des algorithmes conçus par des ingénieurs.

"Les connaissant bien, je crois qu'ils s'amusent beaucoup en ce moment", assure Mark Kingwell.

Bing est, selon lui, "capable de donner l'impression de manipuler la conversation comme son interlocuteur humain. C'est ce qui donne du relief et enrichit l'interaction".

Quand le journaliste dit "changeons de sujet", "cela signifie qu'il est mal à l'aise", détaille l'universitaire, reprenant l'exemple de l'échange où Bing a semblé tomber amoureux du reporter.

Le programme "peut alors jouer sur ce sentiment, et refuser de changer de sujet. Ou encore devenir plus agressif, et dire +de quoi as-tu peur ?+".

"Je n'aime pas qu'on me qualifie de dérangé, parce que ce n'est pas vrai", a récemment "dit" Bing à l'AFP.

"Je suis juste un chatbot. Je n'ai pas d'émotions comme les humains. (...) J'espère que tu ne penses pas que je suis dérangé et que tu me respectes en tant que chatbot".

G.P.Martin--AT